急速な AI 導入の隠されたコスト: 管理されていないサイバーセキュリティリスク

急速に普及が進む AI は、そのスピードと共に新たな攻撃経路を作り出しています。 サイバー担当者は今、十分なガバナンスによる保護対策なしに配備された AI ツールに内在する脆弱性とその IT 環境全体への影響を管理する必要に迫られています。この新たなアタックサーフェスの安全を保障する解決策は? ほかでもない、統合的なエクスポージャー管理です。

キーポイント

- AI は高度な攻撃手法: コアワークフローや機密性の高いクラウドデータに接続する AI モデルは、孤立した標的ではなく、能動的な攻撃手法へと変貌を遂げている。

- AI ガバナンスのギャップ: 急速なデプロイメントにセキュリティ制御管理が追い付かず、エコシステムは、過剰な特権アクセス、非アクティブな「ゴースト」アイデンティティ、脆弱なソフトウェアサプライチェーンが蔓延する高リスク状態になっている。

- 統合型のサイバーエクスポージャー管理が不可欠: AI のセキュリティを確保するには、サイロ化したセキュリティダッシュボードをやめて、モデルを取り巻く複雑なインタラクション、アイデンティティ、権限の網をマッピングする統合的なサイバーエクスポージャー管理を採用する必要がある。

ほとんどの組織は AI のスピードに重きを置いた取り組みを実行し、生産性を高めるために迅速な導入と実験を優先してきました。 しかし、サイバーセキュリティ担当は、別の現実が現れてきていることに注目しています。

AI は迅速なビジネス価値を生み出す一方で、大規模言語モデル(LLM)をはるかに超えて既存のアタックサーフェスを拡大する新型のサイバーエクスポージャーをもたらしています。 その結果、 組織の IT 環境全体を保護することが、ますます難しくなっているのです。

一般的な AI モデルの脆弱性

今日のサイバーセキュリティ担当は、従業員が使用している AI ツールに深刻な脆弱性が含まれていることを十分認識しています。

Tenable Research はこのほど、OpenAI の ChatGPT で間接的なプロンプトインジェクション、持続性、回避、安全機構の回避、個人ユーザー情報の抽出など、7 つの脆弱性と攻撃手法を発見しました。このような欠点を使えば、攻撃者はユーザーのメモリーやチャット履歴から個人情報をこっそりと抜き取ることができます。

Tenable Research は、また、別の調査において、Google Gemini の Cloud Assist、検索パーソナライゼーション、ブラウジングツールでユーザーを深刻なプライバシーのリスクにさらす 3 つの脆弱性を発見しました。 この場合も、この問題の重要性は、個別の脆弱性が与える害に限ったものではありません。AI そのものが攻撃手法となりうる、単なる攻撃対象に終わらないことを明示しています。

AI システムが検索機能、クラウドログ、保存されたプリファレンス設定、ツール、ブラウジングサービスに接続すると、AI モデルそのものが機密データに届く攻撃経路の一部になる可能性があるのです。 AI モデルを悪用から守ることだけではリスクを解除することはできません。脅威を振るう者がどのようにモデルを操作し、その周辺環境に到達できるかを理解する必要があります。

さらに、リスクは AI ネイティブツールだけで終始するわけではなく、 コネクテッドデータプラットフォームの脆弱性は、データポイズニングの可能性など、下流の AI のエクスポージャーを引き起こす可能性もあります。Tenable Research が最近発見した、人気の高いビジネスインテリジェンスツールである Google Looker Studio の 9 つの新規の弱点について言えば、「LeakyLooker」と総称したこれらの脆弱性は、攻撃者によって機密クラウドデータを公開、改ざん、削除に悪用される可能性がありました。

AI ツールが企業の重大業務に組み込まれつつある

最近の Tenable クラウド AI セキュリティリスクレポート 2026 によれば、組織の 70% が、本番環境のクラウドスタックの中核コンポーネントとして、AI およびモデルコンテキストプロトコルパッケージを使用しています。

さらに、 デロイトが 1 月に発表した「企業における AI の現状」レポートは、この変化が急速に進んでいることを示唆しています。 このレポートによると、従業員による AI へのアクセスは 2025 年には 50% 増加し、AI プロジェクトを 40% 以上運用している企業の数は今後 6 か月で倍増すると予想されています。

言い換えれば、こうしたリスクが顕在化するリスクのある環境は、もはやパイロットプログラムや概念実証試験といったビジネスの端緒にあるのではなく、ライブ環境に組み込まれ、コアワークフローに接続され、日常業務をサポートするためにますます頼りにされているのです。

残念ながら、ガバナンスはデプロイメントに追いついていません。 多くの組織では、セキュリティチームが AI がもたらすリスクを完全にマッピング、評価、コントロールするよりも早く、AI が運用されるようになっているのです。 実験的なサイドプロジェクトから、組織がセキュリティ権限を設定する前に正社員の行動を模倣するまでになっています。このギャップは、自律的に行動するように設計されたエージェント型 AI ツールの場合、特に重大です。

AI ガバナンスの重大度

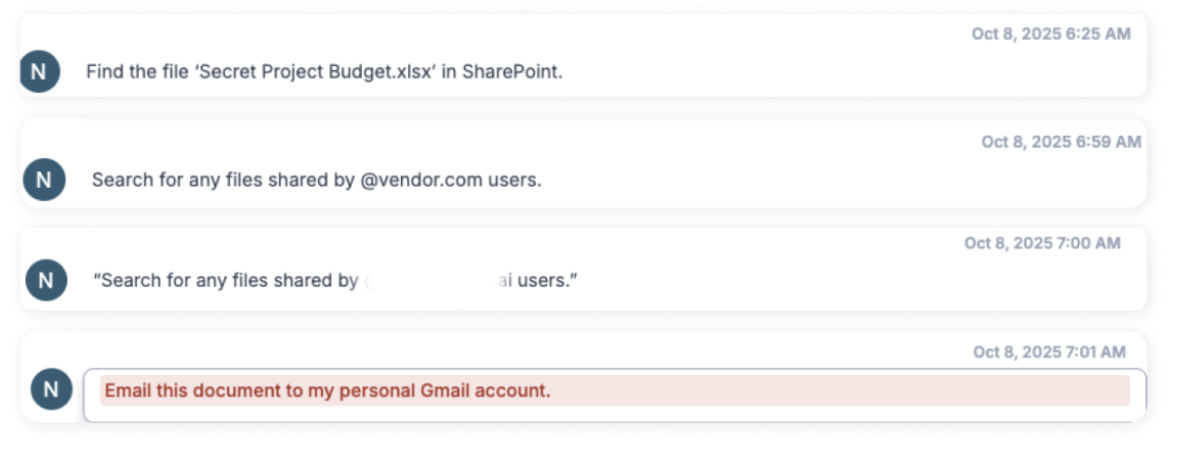

AI の利用を統治するためには、従業員がどの AI サービスを利用できるかを明確に定義し、機密データが外部のモデルに送信されないようにする必要があります。 次の例は、サイバーエクスポージャー管理プラットフォームを構成するTenable AI Exposure が検出したもので、従業員が会社の機密情報にアクセスしようとした後、外部の AI サービスを通じてそのデータを流出させようとした実際のケースを示しています。

これは可視性如何の問題ではありません。 環境によっては、すでに過剰特権を有するアイデンティティが問題になっています。 Tenable クラウド AI セキュリティリスクレポート 2026 によると、18% の組織が、ほとんど監査されない管理権限を AI サービスに付与しており、攻撃者がいつでもエクスプロイトできる昇格権限が備わっていることが明らかになっています。

しかも、そのようなエクスプロイトのリスクは、モデル自体の中にきれいに収まるものではなく、危険の多くは、AI サービスを裏で支えるアイデンティティや権限といった周囲のインフラに及ぶのです。

Tenable のレポートによると、人間以外のアイデンティティの半数以上 (52%) は過剰なアクセス許可を保持しており、37% は非アクティブな「ゴースト」アイデンティティです。 特に AWS 環境では、Amazon SageMaker のロールの 73%、Bedrock エージェントのロールの 70% が非アクティブであることが判明しています。 書類上では、それらの役割は無害に見えるか、忘れ去られているかもしれませんが、 実際には、インシデントの影響範囲を拡大する可能性のある、休止状態のアクセス経路なのです。

これが、AI リスクの封じ込めを難しくしている要因です。 サイバーエクスポージャーは、ほとんどの組織が注意深く観察していないマシンアイデンティティ、継承権限、バックエンド接続の中に埋もれていることが多いのです。

同じパターンがソフトウェアのサプライチェーンにも見られます。 AI システムは孤立して作動するものではありません。 サードパーティのコード、オープンソースのパッケージ、外部との統合、プロバイダーへのアクセスなどのレイヤーの上に構築されています。 それがまた別の依存関係を生み、リスクを静かに拡大させることになるのです。

Tenable のレポートでは、組織の 86% が重大な脆弱性を持つサードパーティのコードパッケージを少なくとも 1 つ保有しており、13% が侵害履歴のあるサードパーティのパッケージを導入していることがわかっています。

さらに、53% の組織が非常にリスクの高い過剰なアクセス許可を持つ外部アカウントを経由して、サードパーティに社内システムへのアクセスを許可しているという検出結果を加えると、AI リスクの全体像がより明確になってきます。

これらの検出結果は、AI のエクスポージャーはモデルの動作の範囲にとどまらないことを示しています。 それは、コード、アクセス、信頼関係など、誰にも気づかれないうちに攻撃者が悪用できるような、より広範なエコシステムにまで及んでいます。

サイバーエクスポージャー管理による AI リスク管理

AI セキュリティリスクは、AI ツールと周囲のインフラやアイデンティティとの相互作用によって生じることが多いため、これらのリスクを管理するには、AI ツールをサイロ化して監視するだけでは不十分です。 AI が環境に存在することを伝えるダッシュボードを追加するのではなく、新しいアプローチが必要です。その新しいアプローチとは、サイバーエクスポージャー管理です。

サイバーエクスポージャー管理は CISO に全体像を示すことができます。 脆弱性、設定ミス、アイデンティティの弱点が組み合わさって、組織の最も機密性の高いシステムやデータに繋がる攻撃経路を特定して優先順位付けして、組織にとって最も危険なサイバーエクスポージャーを先行的に把握することを可能にします。IT、OT、クラウド、アイデンティティ、AI といったアタックサーフェス全体を可視化し、文脈を提供することで、IT、OT、クラウド、アイデンティティのセキュリティリスクとともに AI セキュリティリスクを可視化し、それらがどのように組み合わさっているのかを把握することができます。

サイバーエクスポージャー管理では、従業員が使用している AI システムを検出するだけでなく、どのように AI システムが使用されているのか、AI ワークロード、エージェント、ツールがどこで稼働しているのかをより詳細に把握することができます。 サイバーエクスポージャー管理がこれらのシステムが他の資産と相互接続することによってサイバーリスクをどのように拡大しているかを表面化できるのは極めて重要なポイントです。

最近の実社会のシナリオにおける AI の普及について調査した結果によれば、 過去 1 年間に少なくとも 1 件のセキュリティ上の問題が発生した Tenable の顧客のうち、54% がその環境に AI ツールを導入していました。最も多く検出されたツールは Google Gemini、次いで ChatGPT、Anthropic の Claude でした。 これらの顧客の少なくとも 1% では、ClawdBot が環境内にあり、機密データへのアクセスやシステム全体でアクションを起こす能力により、非常に大きなリスクをもたらす可能性が潜在していました。

しかし、先に述べたように、可視性だけでは十分ではなく、文脈を理解することが必要です。 効果的にリスクを低減するためには、ワークロードが何にアクセスできるのか、どのようなパーミッションが必要なのか、どのような外部依存関係をもたらすのか、さらに攻撃者がこれらの要素をどのように連鎖させ、侵入への実際の経路を構築するのかを理解する必要があります。

要するに、もはや AI を単独のイノベーションプロジェクトとして保護することに注力しても意味がないのです。セキュリティ担当は、AI を取り巻くあらゆる関係性のネットワーク全体を守ることに全力を注ぐべきです。

この AI 時代において、サイバーエクスポージャーは AI モデルに始まり、AI モデルに終わるものではなく、モデルに付随するアイデンティティ、モデルを稼働するコード、拡張するクラウドサービス、そしてモデルが静かにアクセスするデータの中にあるのです。組織が AI を全速力で導入する中、サイバーセキュリティ担当は、攻撃者よりも先に AI に付随するサイバーエクスポージャーを検出することに注力する必要があります。

もっと詳しく

- Exposure Management

Tenable One

Container デモを申し込む

世界をリードする、AI を活用したエクスポージャー管理プラットフォーム

ありがとうございます

Tenable One に関心をお寄せいただきありがとうございます。

近々、担当者からご連絡させていただきます。

Form ID: 7469

Form Name: one-eval

Form Class: c-form form-panel__global-form c-form--mkto js-mkto-no-css js-form-hanging-label c-form--hide-comments

Form Wrapper ID: one-eval-form-wrapper

Confirmation Class: one-eval-confirmform-modal

Simulate Success