サイバーセキュリティニュース: OpenAI の最高経営責任者(CEO)は、米国上院議会で AI 規制に対して証言する、チャット GPT などに対する欧州 AI 規則案

OpenAI の CEO が議員に向けて AI 規制について議会で語った内容、近く制定される EU の法律によって ChatGPT の様式に制約が課される可能性、多くの人が AI に不安を感じているという現実、ダークウェブに関する差し迫った質問に新しい AI チャットボットが即座に答えてくれるかもしれない、という可能性についてご紹介します。また、その他関連トピックについても触れます。

5 月 19 日までの 1 週間で最も気になる 6 つのトピックを徹底解析します。

1 – Altman 氏、ワシントンに赴く

人工知能 (AI) 製品に対して政府の管理がどの程度行われるべきかについて、世界中で活発な議論が引き続き行われており、サイバーセキュリティチームは、規制の風向きを注意深く見守っていく必要があります。

今週、ワシントン D.C. で注目の議論が行われました。ChatGPT を製造する OpenAI の CEO である Sam Altman 氏が 米国の上院司法委員会のプライバシー、テクノロジー、法律に関する小委員会で証言したのです。

Altman 氏は、OpenAI の生成 AI 製品のメリットやそのプライバシーとセキュリティの機能について詳しく述べた後、AI の悪用や乱用を防ぐ鍵は規制にあると議員に語りました。ただし、政府の過度な監督に対して警告も発しました。

「OpenAI は、AI の規制は不可欠であると考えています。また、政策立案者が安全性を奨励すると同時に、人々が技術の利益を享受できるようなバランスが取れた規制を推進する方法を決定する際の支援を行いたいと考えています」と彼は述べました。

ところで Altman 氏は、AI の法律や規制を討議する米国議会に、 何を提案したのでしょうか。 以下はその概要です。

- AI 企業が製品をリリースする前に、社内テストだけでなく社外のテストにも製品を提出し、その結果を公開するという要件

- AI 技術は複雑で急速に進化するため、AI の規則を適用するにあたっての米国政府の柔軟性

- 法律や規制を策定する際の、各国の政府間の連携と協力

「政府と産業界が協力してリスクを管理することで、私たち皆が大きな可能性を見出すことができると信じています」 Altman 氏はこう述べました。

詳しくは、Altman 氏の事前に準備された声明、 Gizmodo、Politico、The Guardian の報道、および以下の動画をご覧ください。

Top Moments From ChatGPT Creator's Congressional Testimony (ChatGPT クリエイターの議会証言における注目の瞬間) (CNET)

OpenAI CEO Testifies Before Senate Judiciary Committee About Artificial Intelligence (OpenAI の CEO が、上院司法委員会で人工知能について証言) (Forbes)

2 – AI 専門家: 生成 AI が責任ある AI プログラムを妨害する

企業が生成 AI 技術を採用するなか、各企業の責任ある AI (RAI) プログラムの大半では、生成 AI に伴うリスクに対処する準備がまだ整っていません。 少なくとも、MIT Sloan Management Review と Boston Consulting Group が助言を求めた AI 専門家の大多数はそのように考えています。

大半の RAI プログラムでは、新しい生成 AI ツールのリスクに対処する準備が整っていない

(出典: 19 人の AI 専門家を対象とした調査に基づく MIT Sloan Management Review)

この専門家集団は、企業が生成 AI ツールのリスク管理に苦戦しているのはなぜか、その主な理由を 3 つ挙げています。

- こういったツールは、他の AI 製品と「質的に異なる」

- こういったツールは、新しいタイプの AI リスクをもたらす

- RAI プログラムが生成 AI の進歩に追いつくことができていない

それでも、MIT Sloan Management Review の記事「Are Responsible AI Programs Ready for Generative AI? Experts Are Doubtful (責任ある AI プログラムは生成 AI に対応しているか? 専門家は懐疑的)」によるとまだ希望はあります。

詳細な推奨事項をまとめたこの記事には「企業の DNA に組み込まれた中核となる RAI の原則を強調するアプローチと、進化する新たなリスクに対応できるよう継続的に適応していく RAI プログラムの組み合わせが有効であると、多くの専門家が強く主張している」と記されています。

責任ある AI について詳しくは以下を参照してください:

- 8 Questions About Using AI Responsibly, Answered (AI の責任ある使用についての 8 つの質問への回答) (Harvard Business Review)

- Responsible AI at Risk: Understanding and Overcoming the Risks of Third-Party AI (責任ある AI に迫るリスク:サードパーティ製 AI のリスクの理解と克服) (MIT Sloan Management Review)

- CSA、組織で ChatGPT を安全に活用する方法に関するガイダンスを提供 (Tenable)

- How AI ethics is coming to the fore with generative AI (AI 倫理がいかに生成 AI によって表面化するのか) (ComputerWeekly)

- ChatGPT の使用は個人情報の侵害につながる可能性がある (Tenable)

3 – 調査: AI はアメリカの多くの人に不安や恐怖を与えている

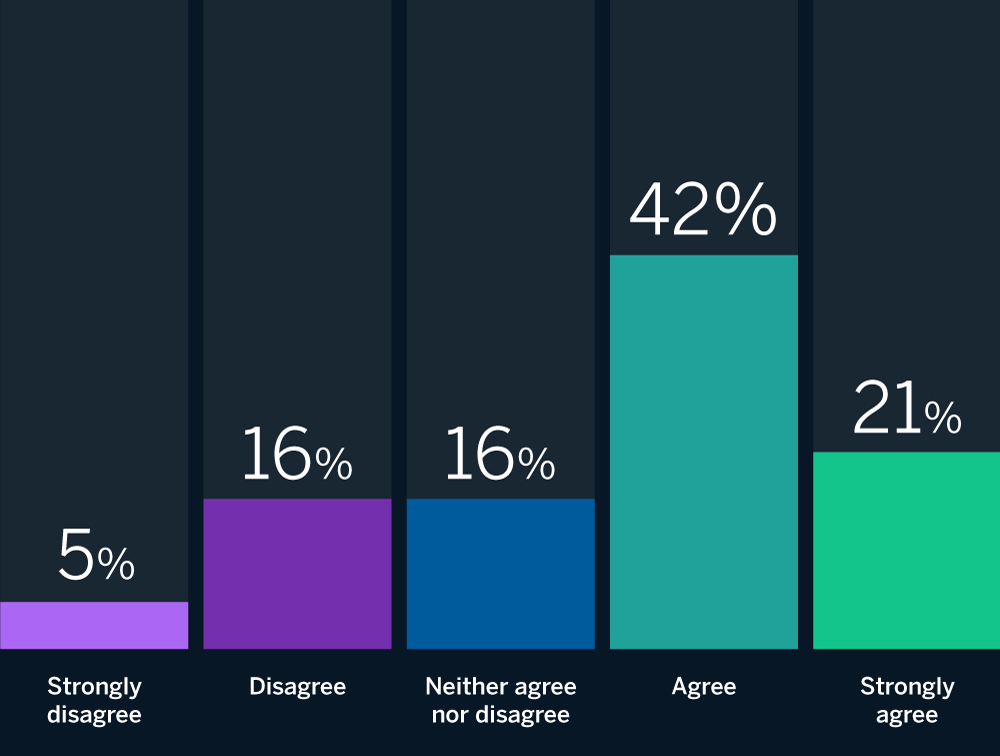

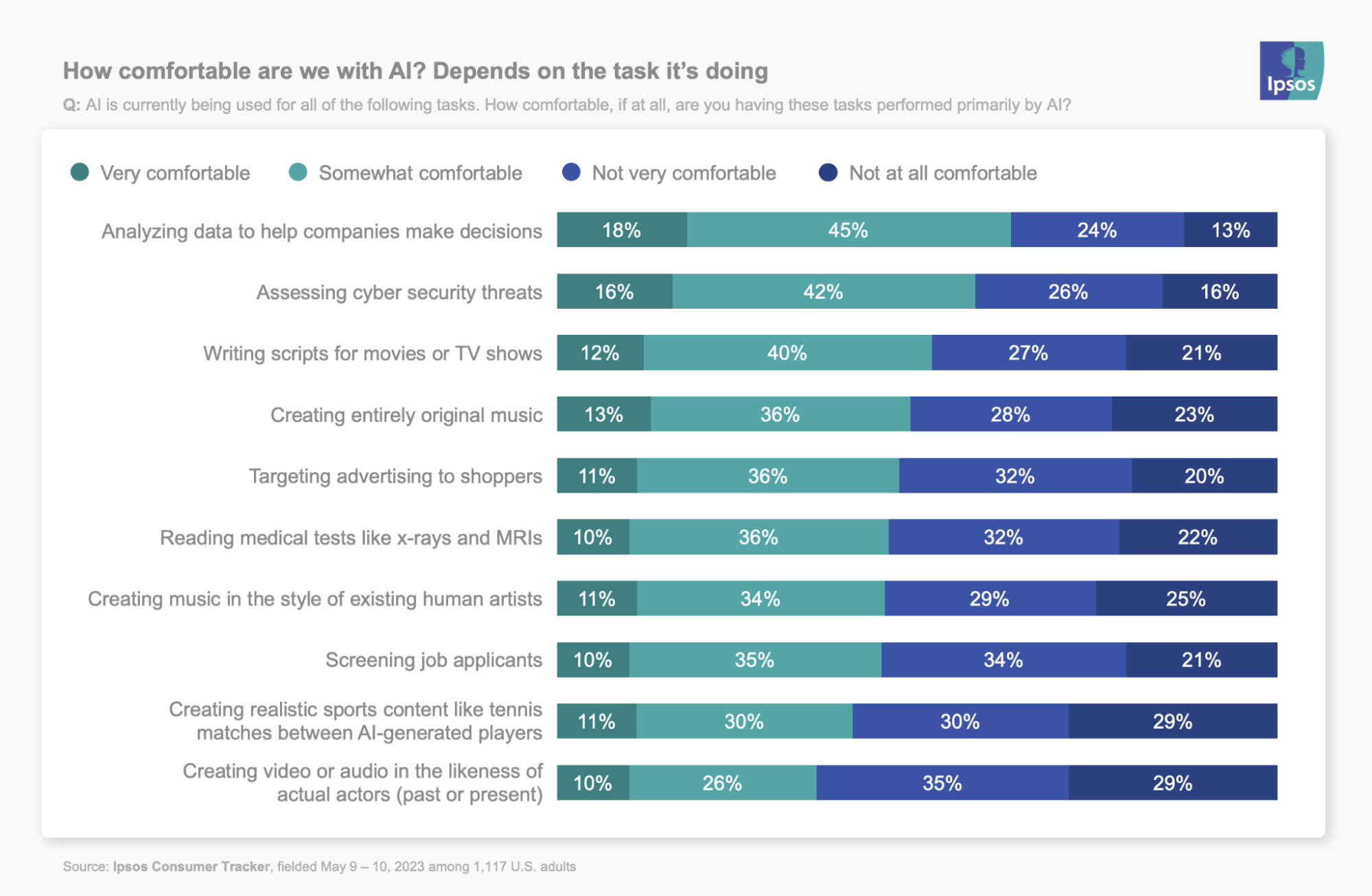

米国内では AI に対して、たとえその技術がサイバーセキュリティの防衛目的で使用される場合でも、多くの人々が懸念を抱いています。

米国の成人 1,117 人を対象とした今週発表の Ipsos 社のオンライン調査では、サイバーセキュリティの脅威を評価するための AI の使用について「非常に安心」と答えた人はわずか 16% でした。 残りの回答者は「やや安心」(42%)、「あまり安心ではない」(26%)、「まったく安心していない」(16%) と評価しました。

また Ipsos によると、回答者のほぼ半数 (46%) が AI ツールの開発スピードが速すぎると感じているのに対し、30% は開発スピードが適切であると答えています。

一方で、4,415 人の米国の成人を対象に Reuter /Ipsos がオンラインで今週行った別の調査では、次のことも明らかになりました。

- 回答者の 61% が AI は「人間にとってリスクをもたらす」と答えており、それに同意しなかった回答者はわずか 22%、意見を表明しなかった回答者は 17% であった

- 回答者の 3 分の 2以上が AI の悪影響を懸念している

AI による負の影響に対する同様の懸念は、より対象範囲の狭い別の調査でも浮上しています。 Boston.com の 400 人超の読者を対象にオンラインで実施した調査では、AI について「無関心」または楽観的に考えていると答えた回答者はわずか 15% であり、残りの回答者はある程度の懸念を抱いていました。27% は「何らかの懸念がある」、40% は「かなり懸念している」、18% は「ほぼパニック状態である」と回答していました。

AI に対する一般的な認識に関する詳細は、以下を参照してください:

- Limited enthusiasm in U.S. over AI’s growing influence in daily life (日常生活における AI の影響力の拡大に対する米国内の熱意は限定的) (Pew Research Center)

- MITRE-Harris Poll Finds Lack of Trust Among Americans in AI Tech (MITRE-Harris 調査により米国人の AI 技術に対する信頼性が低いことが判明) (MITRE)

- Why are we so afraid of AI? (我々が AI を恐れる理由) (The Washington Post)

- ChatGPT Thinks Americans Are Excited About AI.Most Are Not. (ChatGPT の見解によると米国人は AI に興味があるそうだが、大半はそうではない) (FiveThirtyEight)

- Americans Support Congressional AI Action (米国人は議会の AI の法規制を支持する) (Tech Oversight Project)

4 – EU の AI 法は ChatGPT の世界を揺るがしかねない

世界的に AI を取り巻く法律および規制のガードレールの制定がみられる中で、承認プロセスが進んでいる欧州連合 (EU) の AI 法の制定により大きな進展がありそうです。

Artificial Intelligence Act と呼ばれるこの法律によって、とりわけ ChatGPT の OpenAI のような一部の AI ベンダーに対して、製品の訓練データの基盤が著作権法に違反していないことの証明が義務付けられる可能性があります。

先週の発表で、欧州議会は AI 法の現在の進捗状況を取り上げ、生成 AI 製品を対象とした具体的な条項を含む、AI 法の草案に対する最新の重要な追加点や変更点について、その概要を説明しました。

「GPT などの生成系基盤モデルは、コンテンツが AI によって生成されたことを開示したり、違法なコンテンツが生成されないようにモデルを設計したり、トレーニングに使用される著作権で保護されたデータの概要を公開したりするなど、透明性を義務付ける追加要件に準拠する必要があります」と、声明では述べています。

詳細情報

- Europe takes aim at ChatGPT with what might soon be the West’s first A.I. law (欧州は西側諸国初となる見込みの A.I. 法で ChatGPT に狙いを定める) (CNBC)

- The EU and U.S. diverge on AI regulation (AI 規制についての EU と米国の意見の相違) (Brookings Institution)

- Massive Adoption of Generative AI Accelerates Regulation Plans (生成 AI の大規模な採用により規制の予定が早まる) (Infosecurity Magazine)

- EU lawmakers back transparency and safety rules for generative AI (EU 議員は生成 AI の透明性と安全性に関する規則を支持) (TechCrunch)

動画

AI regulation and privacy: How legislation could transform the AI industry (AI の規制とプライバシー: 法律が AI 業界をいかに変革するか) (Yahoo Finance)

The EU's AI Act: A guide to understanding the ambitious plans to regulate artificial intelligence (EU の AI Act: 人工知能を規制するための壮大な計画を理解するためのガイド) (Euronews Next)

5 – こんにちは DarkBERT、私の新しい友達

ダークウェブ (悪意に満ち、不快なインターネットの無法地帯) についての疑問がある場合、まもなく DarkBERT が手助けしてくれるかもしれません。

この生成 AI チャットボットは韓国の研究者グループが発案しました。彼らはダークウェブに関するサイバーセキュリティ研究を支援する大規模言語モデル (LLM) を提供したいと考えていました。 研究者たちは Tor ネットワークをクロールすることで、このインターネットの裏側の部分について DarkBERT を訓練しました。

「私たちは DarkBERT がダークウェブ分野のタスクに対する評価で既存の言語モデルを上回っていることを明らかにし、そういったタスクに使用できる新しいデータセットを導入します。 DarkBERT は、ダークウェブ分野やサイバー脅威産業における将来の研究への応用が期待されています」と、この研究者たちは自身のAI チャットボットに関する論文で述べています。

DarkBERT はまだ一般公開されていません。 開発者はいずれかの時点でこれをリリースする予定ですが、日付については明言していません。

詳細情報

- DarkBERT is the AI that deciphers the language of the dark web (DarkBERT はダークウェブの言語を解読する AI) (Crast)

- Scientists Train New AI Exclusively on the Dark Web (科学者たちがダークウェブのみを対象に新しい AI をトレーニング) (Futurism)

- Dark Web ChatGPT Unleashed: Meet DarkBERT (ダークウェブ ChatGPT の解放: DarkBERT の紹介) (Tom’s Hardware)

- Meet DarkBERT, The Only AI Trained On The Dark Web (ダークウェブで訓練された唯一の AI である DarkBERT の紹介) (IFLScience)

- New AI DarkBERT is trained on the Dark Web (新しい AI である DarkBERT はダークウェブで訓練される) (Dexerto)

6 – IoT セキュリティを取り上げた CIS ホワイトペーパー

Center for Internet Security (CIS) は、ホワイトペーパー「Internet of Things: Embedded Security Guidance (モノのインターネット: 組み込み型セキュリティのガイダンス)」を発表しました。これは IoT ベンダーが、セキュリティをより容易に、計画的にデフォルトで製品に組み込めるよう支援することを目的としています。

このホワイトペーパーの執筆者である CIS 最高技術責任者 Kathleen Moriarty 氏は、ブログ内で、この 74 ページにわたる資料は IoT の専門家による規範的な推奨事項と綿密な調査を紹介しており、IoT ベンダーだけでなくそのお客様もこの資料を利用できると説明しています。

「企業のお客様は、製品の組み込みの IoT セキュリティ要件について、ベンダーとの会話をスムーズに開始することができます。 この資料は、具体的には教育ツールとして使用できるため、ベンダー向けにガイドとして提供できる可能性があります」と彼女は記しています。

IoT セキュリティについて詳しくは、以下を参照してください:

- IoT Security Acquisition Guidance (IoT セキュリティ取得のためのガイダンス) (CISA)

- Ten best practices for securing IoT in your organization (企業内で IoT を保護するための 10 のベストプラクティス) (ZDNet)

- 4 advanced IoT security best practices to boost your defense (4 つの高度な IoT セキュリティに関するベストプラクティスで防御力を強化) (TechTarget)

- Securing the IoT Supply Chain (IoT サプライチェーンの保護) (IoT Security Foundation)

- NIST cybersecurity for IoT program (NIST の IoT プログラム用のサイバーセキュリティ) (NIST)

動画

Do IoT Devices Make Your Network Unsecure? (IoT デバイスによってネットワークが安全でなくなることはありますか?) (Cyber Gray Matter)

- Center for Internet Security (CIS)

- Cloud

- Cybersecurity Snapshot

- Exposure Management

- Risk-based Vulnerability Management